问题说明

在服务器上使用huggingface模型时,如果直接指定模型名称,用AutoTokenizer.from_pretrained(“model_name”),可能会由于网络原因会报错 Failed to connect to huggingface.co port 443 after 75018 ms: Operation time out

因此我们需要下载模型到服务器上,得到模型本地的路径model_dir,再通过AutoTokenizer.from_pretrained(model_dir)方式来使用。

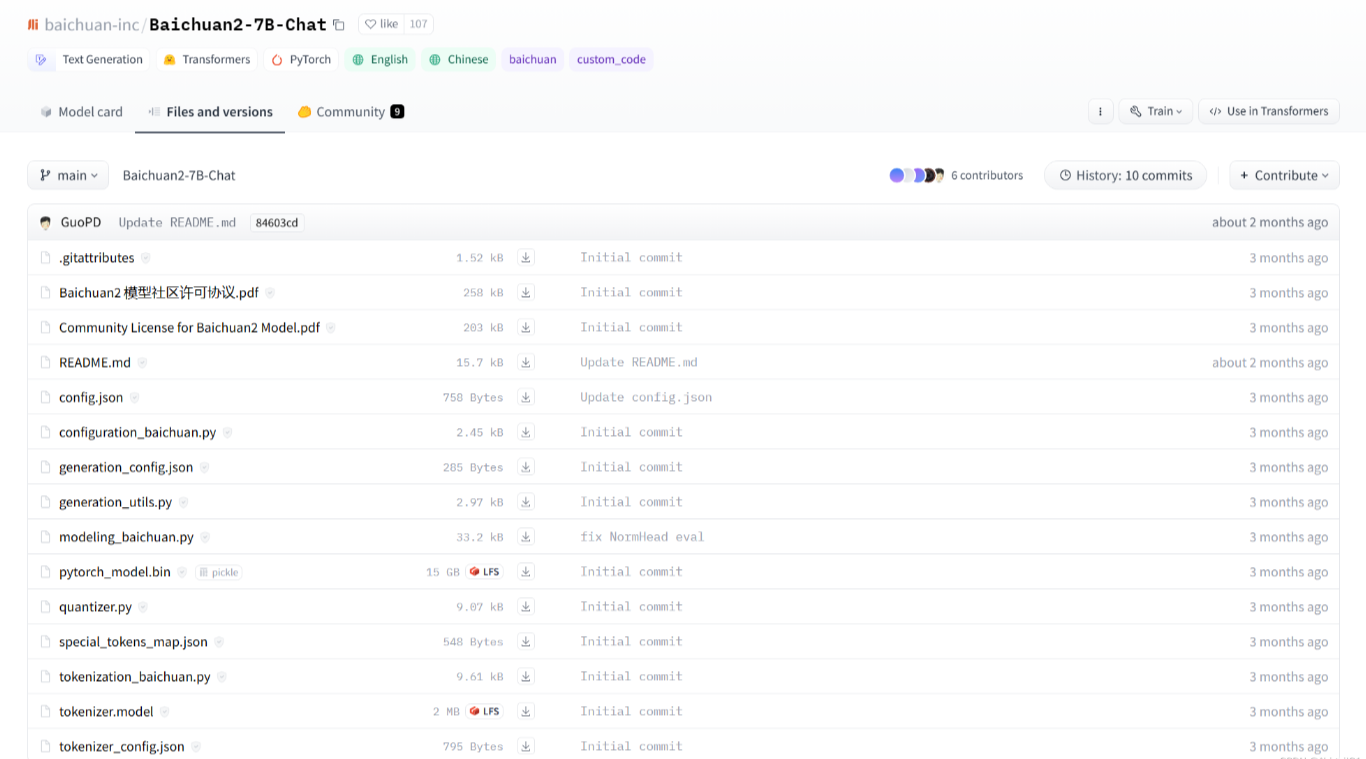

【不推荐】下载方式1:手动从huggingface界面下载相应文件

从huggingface官网挨个下载文件。这种方式需要先下载模型到本地,再上传到服务器上,经过两次传输,很是麻烦。不推荐。

当然如果你只是需要部分文件,就可以这样手动点击下载你需要的几个文件。

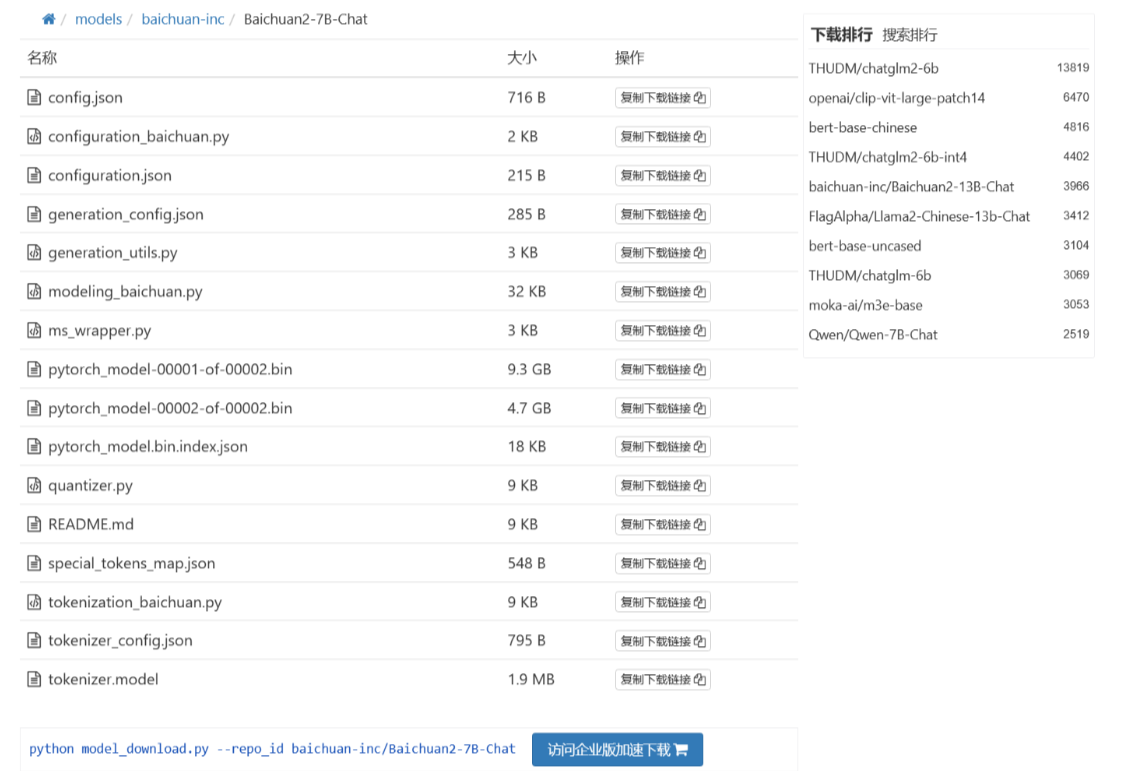

【一般推荐】下载方式2 使用下载器下载

wget https://aliendao.cn/model_download.py

pip install huggingface_hub python model_download.py --repo_id (模型ID)

不知道模型ID的可以去搜索栏搜索模型名称,比如baichuan2-7B-Chat

python model_download.py --repo_id baichuan-inc/Baichuan2-7B-Chat

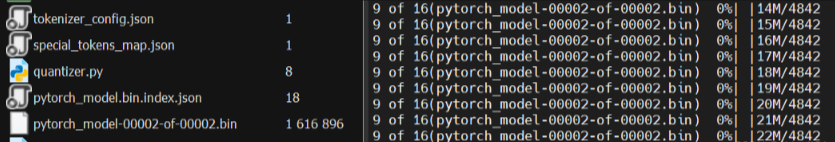

这样就能直接在服务器上下载huggingface模型了,而且会显示下载进度条。速度大约是2M/s

温馨提示

模型下载通常要很久,别忘了打开tmux窗口防止电脑休眠导致网络中断哦

如果你忘了打开tmux窗口也没关系,可以按ctrl-z暂停任务,再打开tmux,重新运行python model_download.py --repo_id 模型id 这行下载代码,可继续下载

【非常推荐】下载方式3 使用huggingface-cli脚本下载

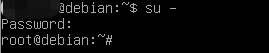

1.首先在linux中输入

2.然后执行

source .bashrc

3.下载huggingface-cli

pip install huggingface-cli

4.准备好你的模型存放路径,以及需要下载的模型id(在huggingface页面复制),执行下面的代码,即可大功告成~ 这种方式下载速度比2快

huggingface-cli download --resume-download (模型名称) --local-dir (模型存放位置) --local-dir-use-symlinks False --resume-download

本文链接:https://blog.runxinyun.com/post/178.html 转载需授权!

留言0